Haben Sie jemals eine Person auf der Straße getroffen, die eins zu eins wie Sie wäre? Kleidung, Gesicht, Gangart, Art der Kommunikation und Gewohnheiten sind völlig identisch mit Ihren. Es ist, als würde man auf einem Drucker gescannt und gedruckt. Klingt ein bisschen gruselig, nicht wahr? Stellen Sie sich nun vor, Sie hätten ein Video gesehen, in dem eine solche Person etwas über sich selbst erzählt. Bestenfalls werden Sie versuchen, sich zu erinnern, wann Sie so gegangen sind, dass Sie sich an nichts erinnern, aber Sie könnten dies vor der Kamera sagen. Das klingt zwar nach einfachem Denken, aber die Technologie ist schon sehr nahe daran, solche Menschen zu schaffen. Sie existieren bereits, aber bald wird es noch viel mehr geben.

Woher kommt die Fälschung?

Jetzt gibt es bereits zu viele Dinge, die allgemein als Fälschungen bezeichnet werden. Sie sind überall. Sie finden sich in Fotografien, in den Nachrichten, in der Warenproduktion und in Informationsdiensten. Es ist einfacher zu sagen, wo es keine Phänomene gibt, die von diesem Wort begleitet werden. Während du sie bekämpfen kannst. Sie können die Herkunft des Fotos untersuchen, die Besonderheiten eines Markenprodukts anhand einer Fälschung überprüfen und die Nachrichten überprüfen. Nachrichten sind jedoch ein separates Thema.

Heutzutage möchte ein Content-Konsument nicht warten und verlangt von seinem Ersteller eine sofortige Produktion. Manchmal kümmert er sich nicht einmal um die Qualität, die Hauptsache ist zu schnell. Hier entstehen Situationen, in denen jemand etwas sagte und die anderen, ohne es zu überprüfen, es von ihren Websites und Zeitungen entfernt haben. In einigen Fällen dauert es lange, diesen Ball zurückzudrehen und zu beweisen, dass alles falsch war.

Es macht keinen Sinn zu erklären, warum dies alles getan wird. Einerseits gibt es diejenigen, die nur über die Situation lachen wollen, andererseits diejenigen, die wirklich nicht wussten, dass sie falsch lagen. Ein separater Platz, ungefähr in der Mitte, wird von denen besetzt, für die es trivial ist, Profit zu machen. Dies können Einflussinteressen auf verschiedenen Ebenen sein, einschließlich der politischen. Manchmal ist dies der Zweck, um Gewinn zu machen. Zum Beispiel Panik an der Börse säen und profitable Transaktionen mit Wertpapieren durchführen. Aber oft ist dies auf die Feindseligkeit gegenüber einer Person (Unternehmen, Produkt usw.) zurückzuführen, um sie herabzusetzen. Ein einfaches Beispiel ist das "Löschen" der Bewertungen eines Films oder einer Institution, die für jemanden nicht wünschenswert sind. Natürlich erfordert dies eine Armee von denen, die gehen und nicht mögen (manchmal sogar Bots), aber das ist eine andere Geschichte.

Was ist Deep Learning?

Werbevideo:

In letzter Zeit klingt dieser Begriff immer häufiger. Manchmal ist er nicht einmal mit dem Fall verwandt und wird mit etwas anderem verwechselt. Das Softwareprodukt sieht also beeindruckender aus.

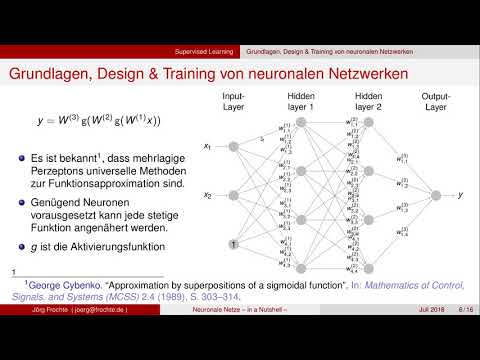

Denken Sie nicht, dass das Konzept und die Grundprinzipien des maschinellen Lernens erst vor wenigen Jahren aufgetaucht sind. Tatsächlich sind sie so viele Jahre alt, dass viele von uns damals noch nicht einmal geboren wurden. Die Grundprinzipien von Deep-Learning-Systemen und die mathematischen Modelle für ihre Funktionsweise waren bereits in den 80er Jahren des letzten Jahrhunderts bekannt.

Zu dieser Zeit machten sie aufgrund des Fehlens einer wichtigen Komponente nicht so viel Sinn. Es war eine hohe Rechenleistung. Erst Mitte der 2000er Jahre erschienen Systeme, die helfen können, in diese Richtung zu arbeiten und alle erforderlichen Informationen zu berechnen. Jetzt haben sich Maschinen noch weiterentwickelt und einige Systeme der Bildverarbeitung, Sprachwahrnehmung und andere arbeiten so effizient, dass sie manchmal sogar die Fähigkeiten einer Person übertreffen. Obwohl sie noch nicht in verantwortungsbewusste Richtungen "eingesperrt" sind, ergänzen sie die menschlichen Fähigkeiten und behalten gleichzeitig die Kontrolle über sie.

Was ist Deepfake? Wann ist Deepfake aufgetaucht?

Es ist leicht zu erraten, dass Deepfake ein kleines Spiel mit Wörtern ist, die mit Deep Learning und den Fälschungen, über die ich oben gesprochen habe, verbunden sind. Das heißt, Deepfake sollte Fälschungen auf ein neues Niveau heben und eine Person in diesem schwierigen Geschäft entladen, damit sie gefälschte Inhalte erstellen kann, ohne Energie zu verschwenden.

Zuallererst betreffen solche Fälschungen Videos. Das heißt, jede Person kann vor der Kamera sitzen und etwas sagen, und ihr Gesicht wird durch eine andere Person ersetzt. Es sieht beängstigend aus, weil Sie in der Tat nur die Grundbewegungen einer Person erfassen müssen und es einfach unmöglich ist, eine Fälschung zu unterscheiden. Mal sehen, wie alles begann.

Das erste generative kontradiktorische Netzwerk wurde von einem Studenten der Stanford University erstellt. Es geschah 2014 und der Name des Studenten war Ian Goodfellow. Tatsächlich stellte er zwei neuronale Netze gegeneinander, von denen eines mit der Erzeugung menschlicher Gesichter befasst war, und das zweite analysierte sie und sprach ähnlich oder nicht. Also trainierten sie sich gegenseitig und eines Tages begann das zweite neuronale Netzwerk verwirrt zu werden und die erzeugten Bilder für real zu halten. Es ist dieses immer komplexere System, das Deepfake hervorbringt.

Jetzt ist Hao Li einer der Hauptförderer der Idee von Deepfake. Er tut nicht nur das, sondern auch viele andere. Dafür wurde er wiederholt mit verschiedenen, auch inoffiziellen Preisen ausgezeichnet. Übrigens ist er einer von denen, denen für das Erscheinen von Animoji auf dem iPhone X gedankt werden sollte. Bei Interesse können Sie sich auf seiner Website näher damit vertraut machen. Heute ist er nicht das Hauptthema der Diskussion.

Wir haben uns nur an ihn erinnert, weil er auf dem Weltwirtschaftsforum in Davos seine Bewerbung gezeigt hat, mit der Sie das Gesicht einer Person, die vor der Kamera sitzt, durch ein anderes Gesicht ersetzen können. Insbesondere zeigte er am Beispiel der Gesichter von Leonardo DiCaprio, Will Smith und anderen berühmten Persönlichkeiten, wie das System funktioniert.

Es sieht ein bisschen gruselig aus. Einerseits können Sie nur die modernen Technologien bewundern, mit denen Sie ein Gesicht scannen, unterwegs in ein anderes ändern und ein neues Bild erstellen können. All dies dauert einen Sekundenbruchteil und das System verlangsamt sich nicht einmal. Das heißt, es ermöglicht nicht nur, das fertige Video zu verarbeiten und das Gesicht zu ersetzen, sondern auch an einer solchen Figur in einer Art Live-Videokommunikation teilzunehmen.

Gefahr von Deepfake. Wie ändere ich das Gesicht eines Videos?

Sie können so viel reden, wie Sie möchten, dass diese Technologie benötigt wird, sie ist sehr cool und Sie müssen nicht verleumden. Sie können sogar bis zum Äußersten gehen und anfangen zu sagen, dass dies die Position eines wilden Oldfags ist, der einfach Angst vor allem Neuen hat, aber es gibt wirklich mehr Gefahren als Vorteile.

Mit dieser Technologie, insbesondere wenn es sich um Open Source handelt, kann jeder surfen und Videos aufnehmen. Es ist nicht schlecht, wenn es nur die Ehre und Würde eines Menschen diffamiert, viel schlimmer, wenn es sich um eine Erklärung handelt, die im Namen einer wichtigen Person abgegeben wurde. Wenn Sie beispielsweise im Auftrag von Tim Cook ein Video aufnehmen, das nur 30 bis 40 Sekunden lang ist, können Sie fast die gesamte US-IT-Sphäre unter der Leitung von Apple zum Erliegen bringen. Der Aktienmarkt wird so hart getroffen, dass die Anleger in Panik geraten. Infolgedessen werden Tausende von Menschen Milliarden von Dollar verlieren.

Jeder, der diese Art des Geldverdienens nicht mag, wird sagen, dass dies das ist, was er braucht. Lassen Sie ihn in die Fabrik gehen. Aber im traurigsten Szenario wird es danach keine Pflanze mehr geben. Darüber hinaus ist es kitschig, dass wir eine Person bekommen, die Wertschwankungen von Wertpapieren betrügt. Es reicht aus, sie nur rechtzeitig zu kaufen und zu verkaufen.

Die Situation könnte noch schlimmer sein, wenn der "Joker" im Namen des Führers eines großen Staates spricht. Natürlich wird dann alles enthüllt, aber während dieser Zeit können Sie viele unangenehme Dinge tun. Vor diesem Hintergrund wäre es ein unschuldiger Streich, einen Schauspieler in einem Erwachsenenfilm einfach durch das Gesicht einer Berühmtheit zu ersetzen.

Bei solchen Technologien ist die Hauptsache das Scannen, und dann ist es eine Frage der Technologie. Im wahrsten Sinne des Wortes.

Sie können sich die umgekehrte Situation vorstellen, wenn eine reale Person etwas sagt und dann jedem versichert, dass sie gerahmt wurde. Wie man in dieser Situation ist, ist ebenfalls nicht sehr klar. Dies führt zu einer solchen Verwirrung in den Newsfeeds, dass es einfach nicht möglich ist, sie in einer anderen Quelle zu überprüfen. Infolgedessen wird allgemein unklar, was in dieser Welt wahr und was falsch ist. Ein Bild entsteht aus Filmen über eine düstere Zukunft wie Surrogates oder Terminator, in denen sich der T-1000 als andere Menschen vorstellte und unter anderem John Conor im Namen seiner Adoptivmutter nannte.

Jetzt spreche ich nicht einmal über einen weiteren Missbrauch, der die Sammlung falscher Beweise ermöglicht. Vor diesem Hintergrund wird der ganze Spaß am Spielzeug zu zweifelhaft.

Wie erkennt man Deepfake?

Das Problem ist nicht einmal, dass solche Systeme verboten werden sollten, sondern dass dies nicht mehr möglich ist. Sie sind bereits vorhanden, und die Entwicklung von Technologien, einschließlich des Lesens von Gesichtern, hat zu ihrem Auftreten und der Verbreitung von Open Source geführt. Selbst wenn wir uns vorstellen, dass das System in seiner gegenwärtigen Form nicht mehr existiert, müssen wir verstehen, dass es neu geschaffen wird. Sie werden neuronalen Netzen wieder einmal beibringen, miteinander zu arbeiten, und das war's.

Bisher ist nicht alles so beängstigend, und Sie können eine Fälschung buchstäblich mit bloßem Auge identifizieren. Das Bild ist ähnlich, aber eher rau. Außerdem hat sie manchmal Mischungsprobleme, insbesondere an den Gesichtsrändern. Aber nichts steht still und es ist überhaupt nicht schwierig, es noch weiter zu entwickeln. Der gleiche Hao Li ist sich sicher, dass dies nicht länger als ein paar Monate dauern wird, und um „Masken“zu erstellen, die selbst ein Computer nicht unterscheiden kann, wird es noch einige Jahre dauern. Danach wird es kein Zurück mehr geben.

Einerseits kann der Algorithmus, den YouTube und Facebook bereits erstellen, davor schützen. Letzteres eröffnete übrigens sogar einen Wettbewerb für die Entwicklung der Erkennungstechnologie - Deepfake Detection Challenge ("Die Aufgabe, Deepfakes zu erkennen"). Der Preisfonds für diesen Wettbewerb beträgt 10 Millionen US-Dollar. Der Wettbewerb ist bereits im Gange und endet im März 2020. Sie können noch Zeit haben, um teilzunehmen.

Das Ersetzen eines Gesichts in einem Video ist kein Problem mehr.

Vielleicht liegt diese Großzügigkeit an einem gefälschten Video mit Mark Zuckerberg selbst. Wenn diese beiden Dinge zusammenhängen, ist die Entstehung eines solchen Wettbewerbs nicht überraschend.

Wenn das ersetzte Gesicht vollständig mit dem Original übereinstimmt, ist die durch ein spezielles neuronales Netzwerk dargestellte Gegenkraft machtlos. In diesem Fall muss sie minimale Unterschiede in Mimik, Bewegungen und Sprechweise feststellen. Bei berühmten Persönlichkeiten wird ein solches Problem auf der Ebene des Videodienstes gelöst, da derselbe YouTube weiß, wie sich der konventionelle Donald Trump bewegt. Wenn es um eine weniger bekannte Person geht, wird es schwieriger. Dies kann jedoch auch bewiesen werden, indem man ihn vor die Kamera stellt und ein ungezwungenes Gespräch führt, während das neuronale Netzwerk seine Bewegungen analysiert. Es wird sich als so etwas wie das Studieren eines Fingerabdrucks herausstellen, aber wie wir sehen können, wird dies wiederum zu unnötigen Schwierigkeiten führen.

Das Einnähen von Videoauthentifizierungssystemen in Kameras kann ebenfalls umgangen werden. Sie können die Kamera das aufgenommene Video markieren lassen und klarstellen, dass es nicht über eine separate Anwendung gefilmt oder in einem speziellen Programm verarbeitet wurde. Aber was ist mit Videos, die gerade verarbeitet wurden? Zum Beispiel ein bearbeitetes Interview. Als Ergebnis erhalten wir ein Video, in dem der Originalschlüssel nicht mehr vorhanden ist.

Ein paar Meme am Ende.

Können wir sagen, dass wir jetzt eines der Szenarien einer dunklen Zukunft skizziert haben? Im Allgemeinen ja. Wenn die Technologien, die zur Erreichung guter Ziele entwickelt wurden, außer Kontrolle geraten, können sie vor Kummer nippen. Tatsächlich gibt es viele Optionen für solche gefährlichen Technologien, aber die meisten sind geschützt. Zum Beispiel Kernfusion. Hier handelt es sich um Code, den jeder bekommen kann.

Schreiben Sie in die Kommentare, wie Sie den Schutz vor Fälschungen sehen, wenn man bedenkt, dass das Maskierungssystem Masken vollständig mit den ursprünglichen Gesichtern identisch machen konnte. Und weil sie auf Video sind, können Sie ihnen nicht einmal Tiefen- und Lautstärkeerkennung zuweisen. Nehmen wir außerdem an, dass jeder im Bild eingebettete Code und Schlüssel gehackt werden kann. Wie sie sagen, wäre es für was. Jetzt können wir diskutieren, die ganze Einführung ist da.

Artem Sutyagin